边缘场景 RobustMQ 的适配思考

一、为什么关注边缘场景

在规划 RobustMQ 的应用方向时,我们最初的目光集中在云端——高吞吐的数据管道、微服务间的消息通信。但随着对 IoT 场景的深入调研,边缘计算逐渐进入视野。

边缘场景有一套与云端截然不同的约束条件,这直接决定了中间件的选型逻辑。本文记录我们的调研思考,以及对 RobustMQ 在边缘场景适配可能性的初步设想。

二、边缘场景的约束条件

边缘设备不是"小一号的服务器",它运行在资源受限、网络不稳定、无人值守的环境里。

四个约束中,内存是最关键的硬约束。边缘设备的内存通常只有几百 MB 到几 GB,磁盘反而相对宽裕(eMMC、SSD 通常 8~256GB)。这意味着中间件的选型标准不是二进制文件大小,而是运行时内存占用——二进制存在磁盘,启动后和磁盘无关;运行时内存才是持续消耗的资源。

网络连接不可靠是边缘场景的另一个本质特征。门店断网、工厂网络抖动、车辆驶出覆盖区域,这些都是日常发生的情况。中间件必须能在断网时本地缓存数据,重连后自动同步,不需要人工干预。

运维能力弱决定了部署门槛的上限。边缘设备分散在各地,没有专职运维,中间件必须做到单二进制、零依赖、配置简单。

延迟敏感度在边缘场景往往被高估。大多数边缘场景对延迟的要求在 1~20ms 之间,不需要亚毫秒。真正需要亚毫秒延迟的场景(高频交易、工业伺服控制)不会选消息中间件,而是直接用点对点通信或专用硬件总线。

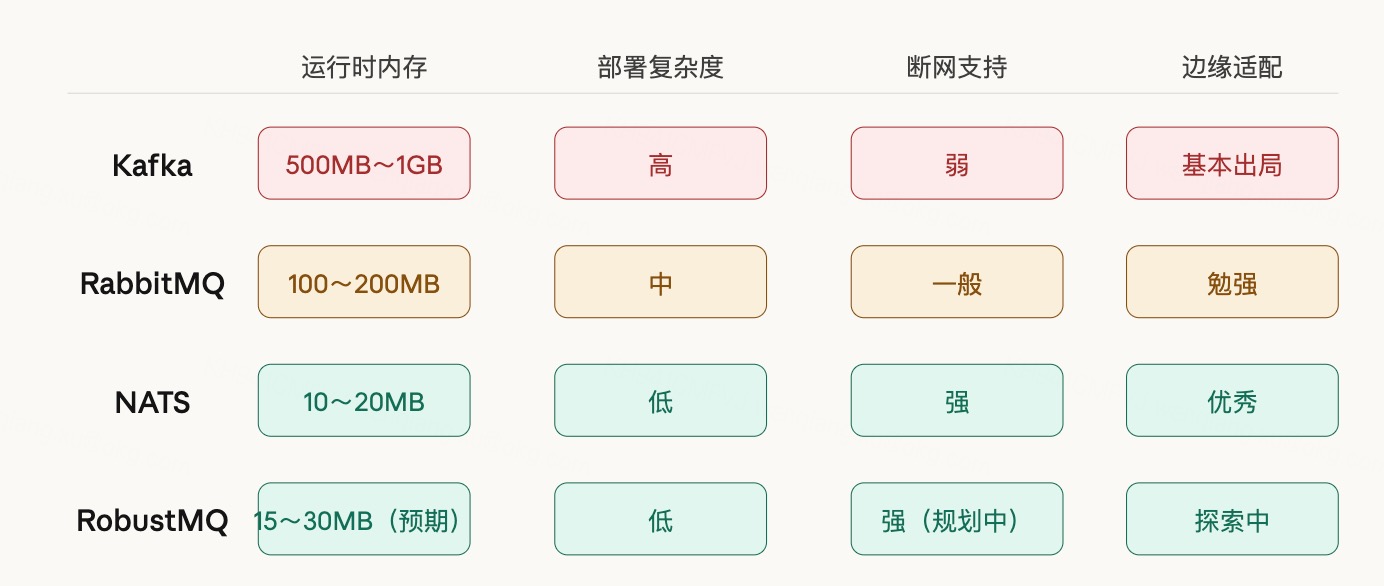

三、中间件选型:为什么 Kafka 出局,NATS 胜出

Kafka 在边缘场景基本出局,原因很简单:JVM 的内存基线是 500MB~1GB,边缘设备根本跑不起来。这不是 Kafka 的设计缺陷,而是它本来就不是为资源受限的环境设计的。

RabbitMQ 依赖 Erlang VM,内存占用 100~200MB,勉强可用,但部署复杂度和断网支持能力都不理想。

NATS 在边缘场景脱颖而出有几个原因:单二进制文件约 20MB,零外部依赖,空载内存仅 10~20MB;JetStream 的 Leaf Node 机制专为边缘设计,断网时本地缓冲,重连后自动同步;Go 编写,跨平台编译简单。

值得一提的是内存的可预测性问题。NATS 用 Go 写,Go 的 GC 会带来周期性的内存波动,平时 20MB,GC 未触发时可能短暂涨到更高。Rust 没有 GC,内存占用稳定可预测。对边缘设备来说,内存峰值的可预测性比平均占用量更重要——不可预测的内存尖峰在无人运维环境里可能直接导致 OOM,且极难排查。

四、MQTT + NATS:边缘场景的天然搭档

MQTT 和 NATS 在边缘场景里分工清晰,互不替代。

MQTT 负责设备层通信。传感器、收银机、摄像头、工控设备,这些终端设备大多原生支持 MQTT。MQTT 的 QoS 机制保证消息不丢失,会话保持让设备断线重连后能补收离线消息。协议本身为低带宽、低功耗、不稳定网络环境设计,天然契合边缘设备的特点。

NATS 负责服务层通信和数据同步。边缘网关内部的多个服务之间需要协调,NATS 的 Pub/Sub 和 Request/Reply 天然适合这种场景。更重要的是 NATS 的 Leaf Node 机制——本地节点连接云端中央集群,断网时数据在本地 JetStream 缓冲,重连后自动同步,整个过程对应用层透明。

Synadia 的博客里记录了一个真实案例:一家零售商在旗下数千家门店部署 NATS Leaf Node,通过 JetStream 的 mirror/source 机制将门店数据同步到云端,网络不稳定时保证门店本地业务不中断。这不是概念验证,是生产中的大规模部署。

五、三个典型场景

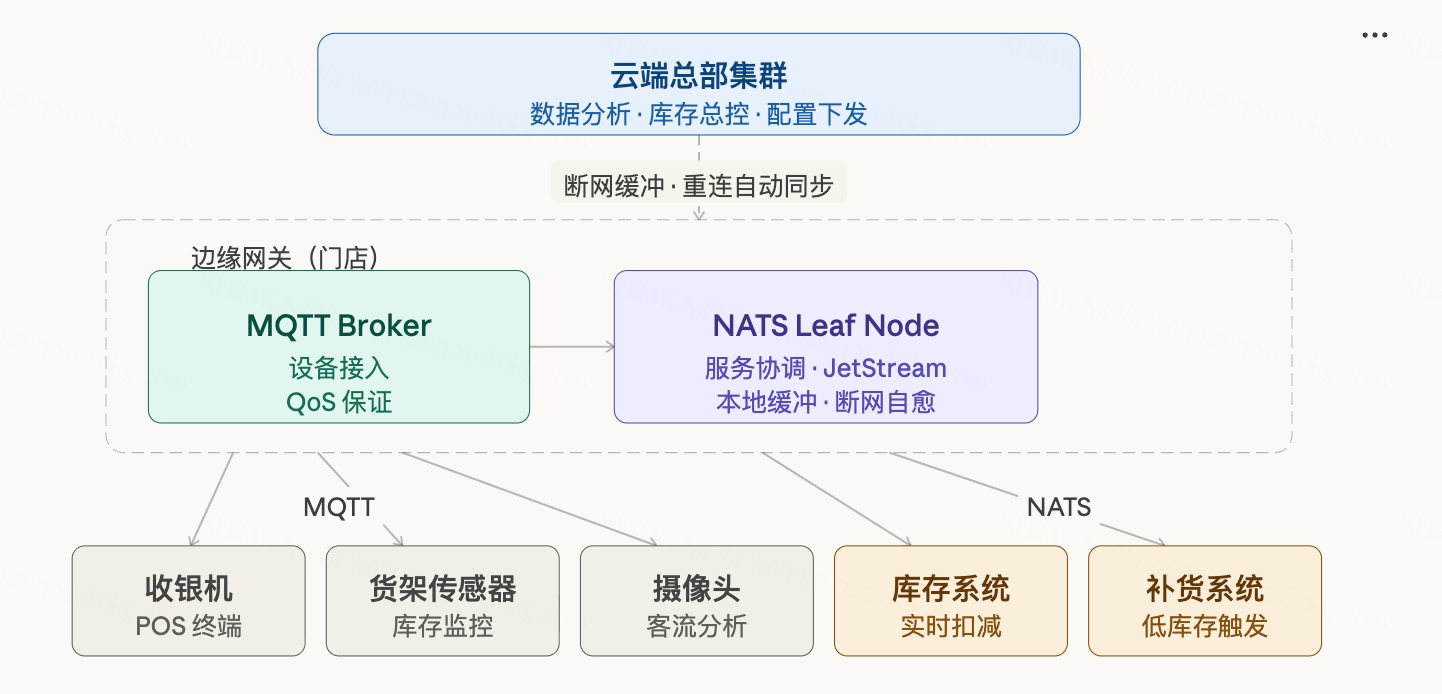

场景一:连锁零售门店

背景和痛点

门店的核心诉求只有一个:断网不能停业。收银机断网、POS 查价失败、积分无法验证,每一分钟都是真实的营收损失。据 Shopify 的调研,一家 200 家门店的连锁商,高峰时段断网 30 分钟,损失就已经无法忽视。而这种情况并不罕见——一根光纤被挖断,一台路由器过热,ISP 在高峰期抖动,都会让所有依赖云端的系统同时瘫痪。

NATS 的官方博客里记录了一个真实案例:一家拥有数千家门店的零售商,原本的系统架构高度依赖云端,一旦断网门店就陷入混乱。他们最终选择了在每家门店部署一个 NATS Leaf Node,通过 JetStream 做本地缓冲和断网同步。

通信架构

门店内有多种设备:收银机、货架传感器(RFID 或重量传感器)、摄像头(客流分析)、数字价签。这些设备大部分原生支持 MQTT,通过 MQTT 接入边缘网关。

边缘网关内部运行两套逻辑:MQTT Broker 负责收拢所有设备的数据,NATS 负责服务间协调——收银完成后通知库存扣减、货架库存低于阈值后触发补货请求、摄像头分析结果推送到数字标牌做实时促销。

与云端的连接通过 NATS Leaf Node 维持。断网时,所有交易数据写入本地 JetStream,门店业务完全不受影响。网络恢复后,数据自动同步总部,不需要任何人工干预。

中间件的具体职责

设备层(MQTT)

收银机 → topic: store/pos/transaction

货架传感器 → topic: store/shelf/{id}/stock

摄像头 → topic: store/camera/traffic

服务层(NATS)

库存服务 ← sub: store/pos/transaction(扣减库存)

补货服务 ← sub: store/shelf/+/stock(低库存触发)

标牌服务 ← sub: store/camera/traffic(实时促销)

云端同步(NATS Leaf Node + JetStream)

断网缓冲 → 本地持久化,重连后自动 mirror 到总部集群关键挑战

边缘网关通常是一台低配工控机,4GB 内存、64GB eMMC。在这个约束下,中间件本身不能吃掉太多资源,必须留给业务应用。这也是 Kafka 在这个场景完全不适用的根本原因——JVM 起步就是 500MB,还没跑业务逻辑。

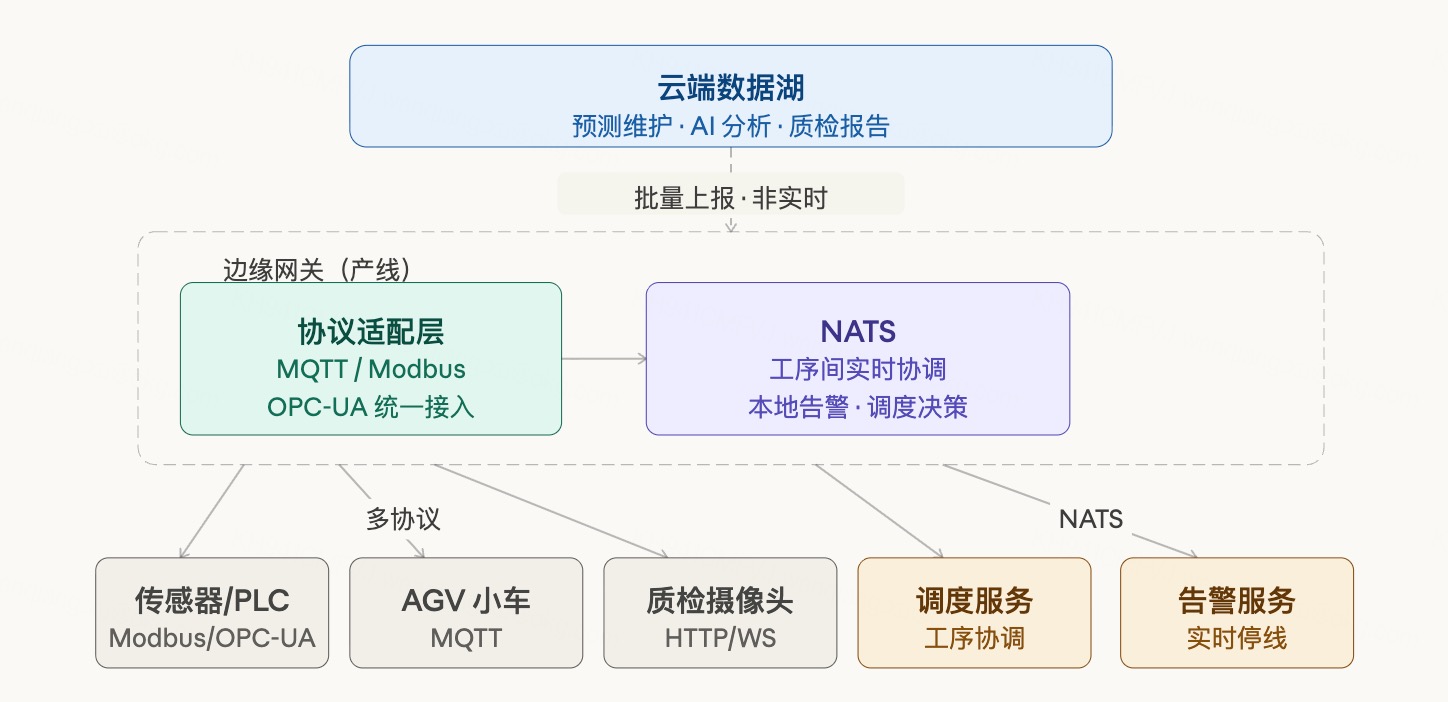

场景二:工厂产线(工业 IoT)

背景和痛点

工业场景的复杂度比零售高一个量级。一条现代产线上可能同时存在:20 年前的 PLC(用 Modbus 通信)、5 年前的传感器(用 OPC-UA)、新采购的 AGV 小车(用 MQTT)、质检摄像头(用 HTTP/WebSocket)。这些设备说不同的语言,数据格式各异,协议互不兼容。

MachineMetrics 是一家工业 IoT 公司,他们的客户是各类制造企业。他们在实际部署中发现:工业 IoT 领域大量设备原生支持 MQTT,同时需要把这些数据接入内部服务做实时分析。他们最终选择了 NATS,原因之一就是 NATS 原生支持 MQTT 客户端直连——设备直接用 MQTT 协议连到 NATS,无需额外的协议转换层。他们的工程师评价:"MQTT 支持基本上是开箱即用,对 IIoT 场景非常关键。"

通信架构

边缘网关在这里承担的角色更重:它不只是数据中转,还要做本地实时决策——产线上的 A 工序完成,必须在几十毫秒内通知 B 工序准备,不能等数据上云再下发指令。

设备层(多协议接入)

传感器/PLC → MQTT/Modbus/OPC-UA → 协议适配层 → 统一 MQTT topic

AGV 小车 → MQTT

质检摄像头 → HTTP/WebSocket → 适配后推入 MQTT

服务层(NATS)

调度服务 → 工序间协调,A 完成 → 通知 B 准备

告警服务 → 设备异常实时触发,本地停线或降速

数据聚合 → 采样、压缩,准备上报

云端(NATS JetStream)

批量上报 → 生产数据、质检结果、设备状态

预测维护 → 云端 AI 分析振动、温度趋势,预判故障延迟的真实要求

工厂场景经常被误认为对延迟要求极高。实际上,产线的节拍时间通常是秒级甚至分钟级(一台车在一道工序上停留 30 秒到几分钟),工序间协调的延迟要求是 10~50ms,而不是亚毫秒。真正需要亚毫秒响应的是伺服电机控制,那是 PLC 和专用现场总线(EtherCAT)负责的,消息中间件根本不介入那个层面。

多协议共存的实际挑战

边缘网关上往往需要同时运行多个协议适配器(Modbus 网关、OPC-UA 客户端、MQTT Broker),每个都是独立进程,消耗独立的内存。如果中间件本身还需要 JVM,资源压力会非常大。轻量、单二进制是工业边缘场景的硬性要求,不是加分项。

场景三:车联网 / 车队管理

背景和痛点

车辆是最极端的边缘场景:设备在高速移动,网络覆盖随时变化,车内有多个计算单元需要实时协调,同时还要把行驶数据持续上报云端。

NATS 的官方文档明确把车辆列为 Leaf Node 的典型部署场景。Synadia 在 KubeCon 2024 发布的 NEX(NATS Execution Engine)专门针对包括车辆在内的边缘场景,支持工作负载在断网时本地运行,网络恢复后自动同步。

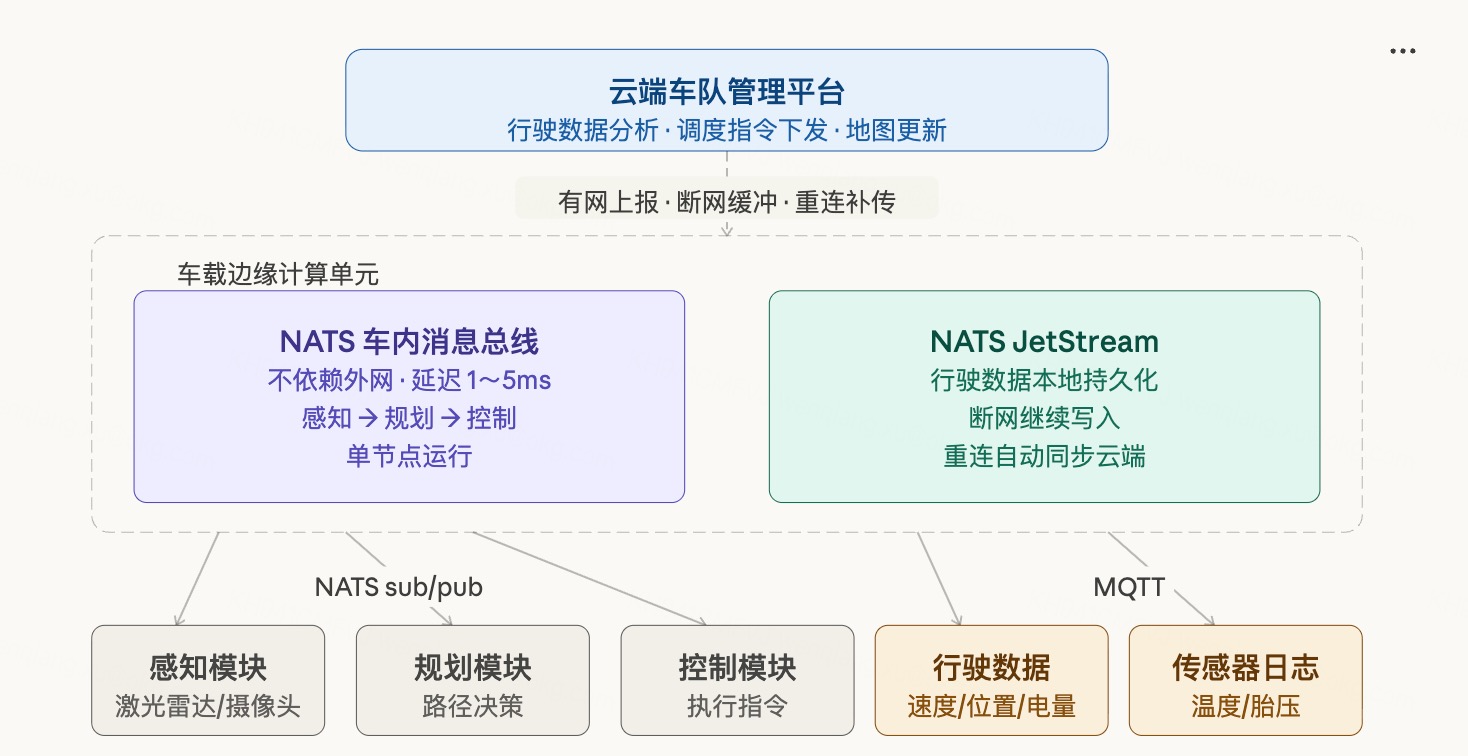

通信架构

车内有两套完全不同的通信需求:

第一套是车内实时通信,延迟要求在 1~5ms,完全不依赖外网。感知模块把障碍物信息推给规划模块,规划模块把路径决策推给控制模块,整个链路在车内闭环,任何外网延迟都不能干扰这个回路。这部分用 NATS 做车内消息总线,部署在车载边缘计算单元上,单节点运行。

第二套是车云数据同步,实时性要求低,但可靠性要求高——行驶数据、传感器日志、地图更新不能丢。这部分用 NATS JetStream 做本地缓冲,有网时上报,断网时暂存,重连后自动补传。

车内通信(NATS,纯本地,不依赖外网)

感知模块(激光雷达/摄像头)

→ pub: vehicle/perception/obstacles

规划模块

← sub: vehicle/perception/obstacles

→ pub: vehicle/planning/path

控制模块

← sub: vehicle/planning/path

车内设备数据采集(MQTT)

温度/电量/胎压传感器 → MQTT → 车载网关

云端数据同步(NATS JetStream Leaf Node)

行驶数据 → 有网时实时上报

传感器日志 → 本地缓冲,批量上传

地图/配置更新 → 云端下发到车辆

断网 → 本地 JetStream 持续写入

重连 → 自动 mirror,数据不丢车队管理的额外维度

对于运营车队(物流货车、网约车、园区摆渡车),还有一个额外需求:车辆之间的调度协调。这通常是云端统一调度,而不是车对车直接通信——调度指令从云端下发,通过 NATS Leaf Node 同步到每辆车的边缘节点。这个模式跟零售门店的 hub-and-spoke 架构完全一致,只是"门店"变成了"车辆"。

资源约束

车载边缘计算单元的内存通常在 4~16GB,比工控机宽裕,但要同时运行感知、规划、控制等 AI 模型,留给通信中间件的预算仍然有限。Rust 写的中间件在这里的优势是内存占用稳定——AI 推理本身已经会周期性地大量占用 GPU/CPU 资源,通信层不能再引入 GC 导致的内存波动。

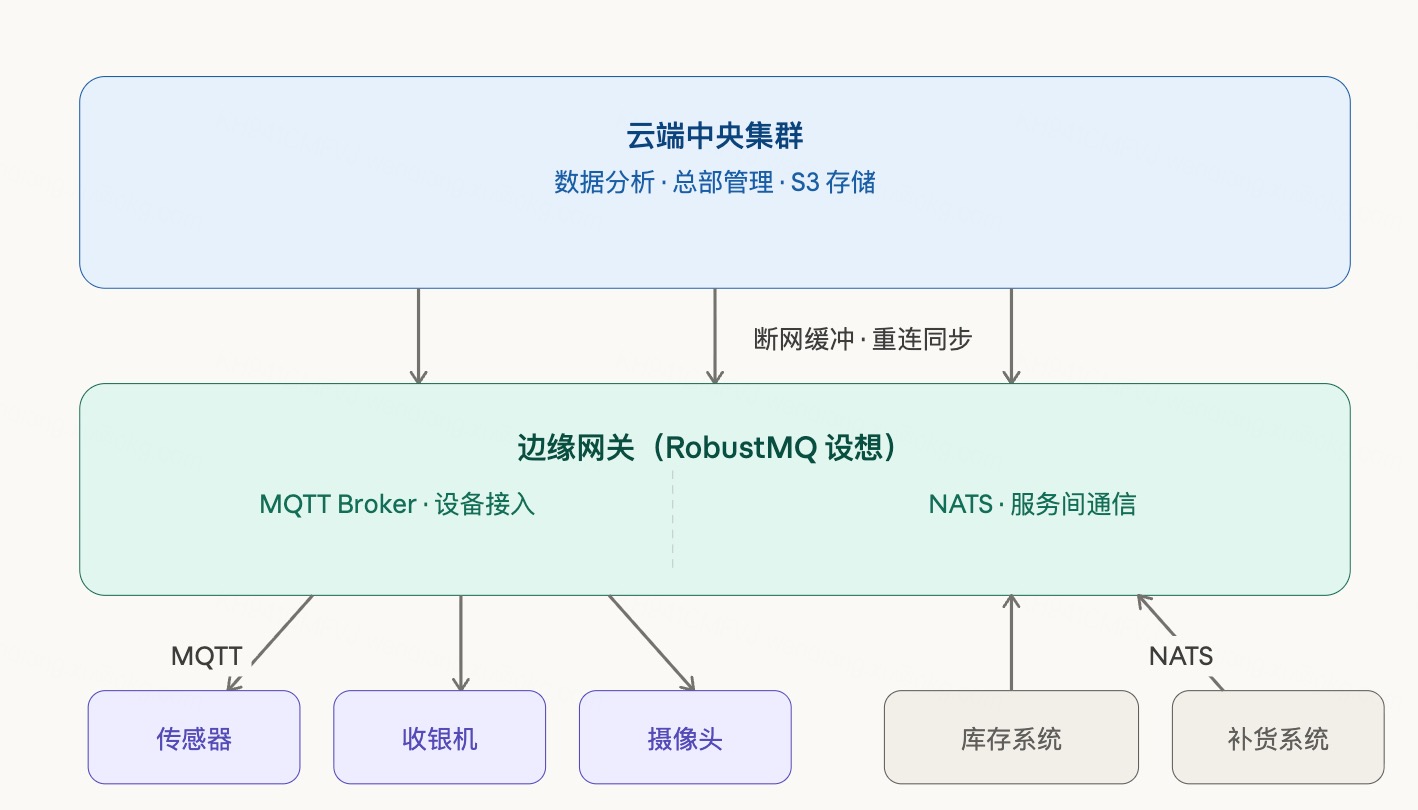

六、RobustMQ 在边缘场景的适配设想

RobustMQ 是多协议统一消息引擎,底层一套存储,上层支持 MQTT、Kafka、NATS 等多种协议。云端场景的价值已经比较清晰,边缘场景是我们正在思考的方向。

可能的优势

Rust 无 GC 的特性使运行时内存占用低且稳定可预测,这在内存稀缺的边缘设备上比 Go 方案更有优势。

协议统一带来的部署简化是实际价值。当前边缘场景的典型部署需要 MQTT Broker + NATS Server 两套系统,两套配置,两套监控。如果 RobustMQ 能在一个进程内同时处理 MQTT 和 NATS,对运维能力弱的边缘场景是实际的减负。

存储后端的可插拔设计天然契合边缘需求:边缘优先用内存存储降低延迟,需要持久化时切 RocksDB,数据卸载到云端走 S3,同一套代码不同配置,不需要为边缘单独维护一个版本。

当前的差距

RobustMQ 目前离边缘场景的生产可用还有距离。MQTT 核心正在完善,NATS 协议兼容还在规划阶段。边缘场景对稳定性要求极高——断网自愈、长时间无人运维——需要充分的测试和验证才能说生产可用。

此外,边缘场景通常是单节点部署,RobustMQ 目前的设计更偏向集群场景,单节点轻量模式还需要专项优化。

这是我们正在探索的方向,不是已经完成的事情。

参考资料

- NATS for Retail: Manage Thousands of Nodes at the Edge — Synadia,真实零售商边缘部署案例

- Edge Computing in Retail 2026 — Shopify,零售边缘计算场景分析

- Edge Computing Use Cases — N-iX,工业边缘计算场景分析

- Bridging the Edge: Using NATS Leaf Nodes — NATS Leaf Node 边缘部署详解

- NATS About — NATS 官方,边缘场景定位说明